L’intelligence artificielle s’installe durablement dans les entreprises. Selon une étude menée en juin 2025 par Bpifrance Le Lab, près d’une entreprise sur deux parmi les PME et ETI françaises ont déjà intégré des solutions d’intelligence artificielle dans leurs outils, leurs processus ou leur système d’information. On n’est plus dans l’expérimentation. L’IA fait désormais partie des choix stratégiques, des décisions opérationnelles et de la gestion quotidienne des données.

Mais plus l’IA prend de la place, plus la question de la gouvernance devient centrale. Derrière chaque modèle, il y a de la donnée — parfois sensible, parfois liée à la vie privée — des règles de décision automatisée, des risques juridiques, des biais potentiels et un cadre réglementaire en pleine évolution, notamment au niveau de l’Union européenne avec l’AI Act. La gouvernance de l’IA ne relève donc pas uniquement de la technique : elle touche au droit, à la conformité réglementaire, à la protection des données, à la transparence, à la sécurité et à la responsabilité des acteurs impliqués.

Mettre en place une gouvernance de l’IA en entreprise est donc essentiel à son bon fonctionnement. Il est indispensable de structurer la gestion des risques, de clarifier les rôles, de poser un cadre de contrôle et de garantir que les systèmes d’intelligence artificielle respectent les exigences réglementaires et les principes éthiques. Parce qu’au fond, il en va de la protection de l’organisation, de ses données, de ses ressources et de sa réputation.Dans cet article, on va poser les bases d’une gouvernance de l’IA claire et opérationnelle, comprendre les enjeux, identifier les responsabilités et voir comment la structurer concrètement dans organisation réelle, avec des contraintes métiers, techniques et réglementaires.

Qu’est-ce que la gouvernance de l’IA ? définition, périmètre et enjeux stratégiques

La gouvernance de l’IA désigne l’ensemble des règles, des politiques et des mécanismes de contrôle qui encadrent le développement, le déploiement et l’utilisation des systèmes d’intelligence artificielle au sein d’une entreprise ou d’une organisation publique. Elle constitue un cadre de gouvernance structuré qui vise à assurer la conformité réglementaire, la sécurité, la transparence et le respect des principes éthiques, des directives éthiques et des réglementations tout au long du cycle de vie d’un modèle.

Concrètement, une gouvernance efficace de l’intelligence artificielle ne se limite pas à une charte ou à une déclaration de principe. Elle repose sur des pratiques opérationnelles : documentation des modèles de machine learning, traçabilité des données d’entraînement, évaluation des risques, intégration de contrôles lors de la mise en production, suivi des performances, audit interne et mesure d’indicateurs clés. L’objectif est double : prévenir les risques potentiels — biais algorithmiques, dérive de modèle, atteinte à la vie privée, utilisation abusive des données — et garantir que les décisions automatisées restent explicables, justifiables et conformes au droit et aux réglementations applicables.

La gouvernance de l’IA s’inscrit également dans un environnement réglementaire de plus en plus structurant. Entre les exigences de protection des données, les obligations de conformité liées à l’AI Act et les recommandations portées par des institutions internationales comme l’OCDE ou le Conseil de l’Europe, les entreprises doivent démontrer qu’elles maîtrisent leurs systèmes d’intelligence artificielle. Cela implique d’identifier clairement les acteurs de la gouvernance, de définir les responsabilités, de formaliser des procédures et d’assurer une surveillance continue des usages, en cohérence avec les directives éthiques et les réglementations en vigueur.

Il est essentiel de distinguer la gouvernance de l’IA de la gouvernance des données ou de la gouvernance IT classique. La gouvernance des données se concentre principalement sur la qualité, la sécurité et la protection de la data. La gouvernance IT encadre l’infrastructure et les outils numériques. La gouvernance de l’intelligence artificielle, elle, traite spécifiquement des modèles, de la prise de décision automatisée, de l’équité, de l’explicabilité, de l’intervention humaine et de l’impact des systèmes sur les utilisateurs et la société. Elle intègre des dimensions techniques, juridiques, organisationnelles et éthiques dans une même logique de maîtrise.En résumé, le rôle de la gouvernance est d’assurer que l’IA reste un levier de valeur et d’innovation pour l’entreprise, sans compromettre la confiance, la conformité ou la responsabilité. Elle ne repose pas uniquement sur la technologie, mais sur une organisation capable de piloter, mesurer et adapter ses systèmes d’intelligence artificielle de manière responsable et durable.

Les principes fondamentaux d’une gouvernance IA solide et responsable

Une gouvernance de l’IA repose sur des principes de gouvernance clairs qui structurent la conception, le déploiement et le suivi des systèmes d’intelligence artificielle. Ces principes ne sont pas théoriques : ils doivent guider les décisions techniques, organisationnelles et juridiques dans chaque projet.

Transparence et explicabilité

Un système d’IA doit pouvoir être expliqué. Cela signifie être capable de documenter les données utilisées, les choix de conception du modèle et les critères qui influencent une décision automatisée.

Dans la pratique, cela implique :

- une traçabilité des données d’entraînement,

- une documentation du cycle de vie du modèle,

- des mécanismes d’explicabilité adaptés au contexte,

- une communication compréhensible pour les équipes métiers, la direction ou les autorités de contrôle.

Sans explicabilité, il devient difficile de justifier une décision ou de corriger un problème.

Éthique et maîtrise des biais

Les modèles apprennent à partir de données existantes. Si ces données reflètent des biais sociaux ou économiques, les modèles peuvent les reproduire ou les amplifier, en particulier dans des domaines sensibles comme le recrutement, le crédit ou les services publics.

La gouvernance des algorithmes impose donc :

- d’évaluer la qualité et la représentativité des jeux de données ;

- d’identifier les risques de discrimination ou d’atteinte aux droits de l’homme ;

- d’intégrer des indicateurs au-delà de la simple performance technique ;

- d’assurer une supervision humaine pour les systèmes à haut risque au sens de la loi européenne.

L’objectif est d’éviter des décisions discriminatoires ou des impacts négatifs sur certains groupes.

Responsabilité et supervision humaine

Un outil d’intelligence artificielle ne peut pas porter une responsabilité juridique. L’entreprise, si. Il est donc indispensable d’identifier clairement les rôles : qui valide le modèle, qui suit ses performances, qui intervient en cas de dérive.

Cela suppose :

- de formaliser les rôles et les responsabilités ;

- de définir des procédures d’audit et de surveillance ;

- de maintenir une capacité d’intervention humaine dans les processus critiques ;

- d’intégrer ces éléments dans la feuille de route IA de l’organisation.

La supervision humaine reste un élément clé, notamment pour les systèmes à haut niveau de risque.

Sécurité, protection des données et conformité

La gouvernance de l’IA est indissociable de la protection des données et de la sécurité des systèmes d’information. Elle impose une utilisation responsable des modèles, le respect de la vie privée et une vigilance sur la propriété intellectuelle, notamment lors de l’usage de modèles externes ou de contenus générés. Avec le RGPD, l’AI Act et les recommandations européennes ou internationales, le cadre réglementaire se renforce. Les entreprises doivent donc démontrer qu’elles maîtrisent leurs systèmes et qu’elles assurent leur conformité.

Dans un projet IA, cela signifie :

- sécuriser l’accès aux données et aux modèles,

- contrôler les environnements d’entraînement et de déploiement,

- intégrer les exigences du cadre réglementaire dès la conception,

- documenter les mesures mises en place.

La conformité ne doit pas être traitée après coup. Elle fait partie du projet dès le départ.

Robustesse et suivi dans le temps

Un modèle peut évoluer ou dériver en fonction des données et des usages. La gouvernance doit donc prévoir un suivi continu.

Cela passe par :

- la surveillance des performances en temps réel lorsque nécessaire ;

- la détection des dérives ;

- la définition de KPI clairs pour évaluer l’efficacité ;

- des actions correctives documentées ;

- des étapes formalisées dans le cycle de vie du modèle.

La mise en production n’est pas la fin du projet. C’est le début d’un cycle de suivi.

Ces principes structurent une gouvernance responsable et durable. Ils permettent de déployer des systèmes d’intelligence artificielle à grande échelle, tout en maîtrisant les risques, en protégeant les données et en maintenant la confiance des utilisateurs et des parties prenantes.

Les acteurs, responsabilités et cadre réglementaire à suivre

La gouvernance de l’IA implique plusieurs niveaux d’intervention. Elle s’organise autour d’un cadre réglementaire externe, d’une traduction stratégique au niveau de l’entreprise et d’une mise en œuvre opérationnelle dans les projets. Comprendre cette structuration permet de clarifier qui fait quoi et comment les responsabilités s’articulent.

| Niveau | Acteurs clés | Rôle principal | Ce que ça implique concrètement |

| Réglementaire / Externe | Union européenne (AI Act) Autorités de protection des données Commission européenne OCDE Normes sectorielles | Fixer le cadre légal et les exigences en matière de gouvernance de l’IA | – Classification des systèmes selon le niveau de risque – Exigences de transparence et d’explicabilité – Documentation obligatoire – Obligations liées à la protection des données – Possibilité d’audits et de contrôles |

| Stratégique | Direction générale Conseil d’administration Comité de gouvernance IA | Traduire le cadre réglementaire en stratégie d’entreprise | – Définir les usages alignés avec la stratégie – Arbitrer le niveau de risque acceptable – Allouer les ressources – Formaliser un cadre de gouvernance interne |

| Opérationnel | DSI / CTO Équipes data & IA RSSI DPO Métiers | Mettre en œuvre la gouvernance dans les projets IA | – Documenter les modèles et les données – Intégrer les contrôles dans le cycle de vie – Assurer la sécurité et la conformité – Mettre en place la surveillance continue – Mesurer les performances et détecter les dérives |

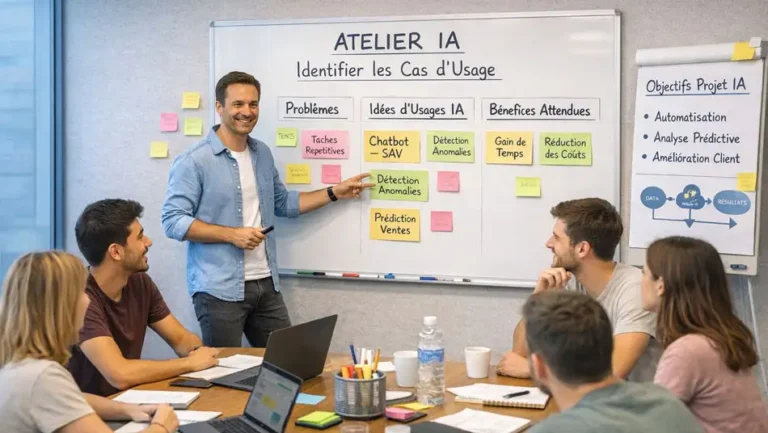

Exemple de méthode pragmatique pour mettre en place une gouvernance IA en PME

Pour une PME, la gouvernance de l’IA doit rester proportionnée. L’objectif est d’obtenir de la visibilité, de maîtriser les risques liés aux données et de structurer les usages, sans créer une organisation lourde.

Voici une méthode en 5 étapes pour une gouvernance robuste, déployable en trois mois.

Étape 1 – Recenser les usages IA existants (Semaines 1 à 4)

La première étape consiste à identifier concrètement où et comment l’intelligence artificielle est utilisée dans l’entreprise.

Cela inclut :

- outils SaaS intégrant de l’IA générative

- automatisations métier

- scripts internes utilisant des API externes

- expérimentations locales menées par certaines équipes

Il faut également préciser :

– quelles données sont utilisées

– si ces données sont sensibles ou personnelles

– quel est l’impact des décisions produites

Livrable attendu :

Un registre centralisé (tableur ou outil interne) recensant tous les usages, avec un responsable identifié pour chacun.

Étape 2 – Classer les usages selon leur niveau de risque (Semaines 3 à 6)

Une fois les usages recensés, ils doivent être qualifiés.

Une PME peut utiliser une grille simple basée sur deux critères :

- impact métier

- sensibilité des données

Cela permet de distinguer :

– usages à faible impact

– usages structurants avec validation humaine

– usages sensibles ou décisionnels

Livrable attendu :

Une matrice interne de criticité et une classification formalisée des usages.

Cette étape permet d’adapter le niveau de contrôle au niveau de risque.

Étape 3 – Formaliser un cadre d’usage interne (Semaines 5 à 8)

Il ne s’agit pas de produire un document long. Un cadre de 3 à 5 pages suffit.

Il doit préciser :

- quelles données ne peuvent pas être injectées dans des outils publics

- quelles validations sont nécessaires avant mise en production

- quelles exigences minimales de documentation sont attendues

- quand une supervision humaine est obligatoire

Un référent IA doit être identifié. Dans une PME, il s’agit souvent du CTO, du DSI ou du responsable transformation.

Livrable attendu :

Une politique interne en cohérence avec la stratégie de l’entreprise validée par la direction et diffusée aux équipes.

Étape 4 – Intégrer la gouvernance dans les projets (Semaines 8 à 12)

La gouvernance doit être intégrée dans les processus existants.

Concrètement :

- ajouter une question “usage IA” dans les phases de cadrage projet

- intégrer une fiche standard pour documenter les modèles

- prévoir une validation par le référent IA pour les usages sensibles

- conserver une trace des versions et des décisions clés

Livrables :

Un modèle de fiche projet IA et un schéma simple du cycle de validation.

Étape 5 – Mettre en place un suivi trimestriel (À partir du mois 3)

Une revue trimestrielle suffit dans la majorité des PME pour améliorer l’efficacité.

Elle doit permettre de :

- mettre à jour le registre

- identifier de nouveaux usages

- signaler les incidents éventuels

- suivre les évolutions réglementaires majeures

Quelques indicateurs de performance simples peuvent être suivis :

– nombre d’usages IA recensés

– part documentée

– nombre d’usages sensibles

– incidents liés aux données

L’objectif n’est pas de produire un reporting complexe, mais de maintenir un pilotage régulier.

Résultat attendu après 3 mois

La PME dispose :

- d’une vision claire de ses usages IA

- d’un cadre d’utilisation formalisé

- d’un référent identifié

- d’un processus intégré aux projets

- d’un suivi régulier

Ce dispositif reste léger, mais il permet déjà de maîtriser les principaux risques liés à l’utilisation de l’intelligence artificielle.

Outils et technologies au service de la gouvernance IA

La gouvernance de l’IA ne repose pas uniquement sur des politiques internes. À mesure que les modèles se multiplient, que l’intelligence artificielle générative s’intègre dans les produits et que les usages deviennent plus critiques, certains outils deviennent nécessaires pour documenter, surveiller et sécuriser les systèmes.

Les outils ne remplacent pas l’organisation. Ils viennent soutenir des processus déjà définis : documentation, validation, monitoring, audit, gestion des accès.

Voici un panorama des principales catégories d’outils, avec des exemples concrets.

Panorama des principales catégories d’outils

| Catégorie | Rôle principal | Exemples d’outils | Quand les utiliser |

| Documentation & règles internes | Formaliser les politiques IA, centraliser les règles, maintenir un référentiel partagé | Notion, Confluence, Google Workspace, README structuré dans les repositories | Dès les premiers projets IA structurés |

| Registre de modèles / Model registry | Centraliser les informations sur les modèles (propriétaire, données utilisées, version, métriques) | MLflow Model Registry, Weights & Biases, DataHub | À partir de plusieurs modèles en production |

| Monitoring & observabilité LLM / IA générative | Suivre les performances, analyser les prompts, détecter les dérives et incidents | Langfuse, LangSmith, Weights & Biases, Arize AI | Dès qu’un modèle est exposé à des utilisateurs |

| Gestion du cycle de vie ML (MLOps) | Versioning, tracking des expérimentations, reproductibilité | MLflow, Kubeflow, SageMaker, Vertex AI | Lors d’une industrialisation |

| Traçabilité & auditabilité | Journalisation des décisions, conservation des logs, conformité | Outils de logging (ELK stack), Datadog, solutions cloud natives | Si décisions à impact métier |

| Gestion des risques & conformité IA | Formaliser l’évaluation des risques, suivre la conformité réglementaire | TrustArc, OneTrust (RGPD), registres internes adaptés AI Act | En cas d’usage sensible ou réglementé |

| Sécurité cloud & contrôle d’accès | Sécuriser environnements, modèles et données | Wiz, AWS IAM, Azure RBAC, Google IAM | Dès hébergement cloud |

Quelques cas concrets d’utilisation

- Un README structuré dans chaque repository peut suffire pour documenter un modèle interne (objectif, données d’entraînement, limites connues, métriques).

- Notion ou Confluence peuvent héberger la politique IA, les procédures de validation et le registre des usages.

- Langfuse ou LangSmith permettent de monitorer des applications basées sur des LLM : suivi des prompts, latence, taux d’erreur, analyse des retours utilisateurs.

- MLflow permet de tracer les versions d’un modèle, comparer les expérimentations et conserver un historique exploitable en cas d’audit.

- Des solutions comme Wiz permettent de renforcer la sécurité des environnements cloud et d’identifier des mauvaises configurations susceptibles d’exposer des données sensibles.

Gouvernance augmentée par l’IA

Certaines organisations mettent en place :

- détection automatique de dérive (data drift / model drift)

- scoring automatique du niveau de risque d’un usage

- analyse des logs pour identifier des comportements anormaux

- génération automatique de documentation à partir du code

Ces mécanismes permettent d’automatiser une partie de la surveillance, tout en conservant une validation humaine sur les décisions critiques.

Conclusion : une gouvernance pragmatique, adaptée à la réalité des entreprises

Aujourd’hui, le plus gros risque lié à l’IA n’est pas toujours technique. Il est souvent organisationnel. Des données sensibles copiées dans ChatGPT, des prompts contenant des informations clients, des équipes qui utilisent des outils externes sans savoir où part la donnée. Ce sont ces usages quotidiens, mal encadrés, qui exposent réellement une entreprise.

Beaucoup d’organisations sont encore en phase d’expérimentation. Elles testent des agents, des chatbots, des modèles génératifs. Mais peu ont réellement structuré leur gouvernance. Or une fuite de données, une mauvaise configuration ou une utilisation imprudente d’un LLM propriétaire peut avoir un impact direct sur le business et la réputation.

C’est la même chose pour les agents déployés en production. Un agent connecté à des bases internes sans contrôle fin des accès peut devenir un point d’exposition majeur. La gouvernance ne doit donc pas être pensée uniquement côté juridique. Elle doit être intégrée dans l’architecture.

Des approches comme le Model Context Protocol permettent justement de mieux maîtriser les flux, de cloisonner les accès et d’éviter que des modèles externes exploitent des données sensibles sans contrôle. La technique devient alors un levier concret de gouvernance.

Notre position est simple. La gouvernance IA doit être pragmatique, intégrée dès le cadrage et pensée jusqu’au déploiement. C’est ce qui permet de construire des agents et des chatbots sécurisés, de limiter les dérives et d’industrialiser l’IA sans perdre la maîtrise.

Besoin de structurer votre gouvernance IA ?

Si vous déployez des agents, des chatbots ou des outils d’intelligence artificielle et que vous souhaitez sécuriser vos usages, cadrer vos pratiques et éviter les dérives, on peut vous accompagner.